Le développement fulgurant de l’intelligence artificielle (IA) attire l’attention des organisations non gouvernementales (ONG) à travers le monde, qui s’inquiètent des implications éthiques et sociales de ces technologies. En effet, une centaine d’ONG, dont Amnesty International et la Ligue des droits de l’homme, ont co-signé une tribune mettant en garde contre les conséquences néfastes de l’IA sur les droits humains et la justice environnementale. Alors que les technologies d’IA continuent d’évoluer, les enjeux auxquels nous faisons face ne se limitent pas à des considérations techniques, mais touchent également des questions profondes liées à l’équité, la discrimination et la durabilité.

Les préoccupations autour des biais des algorithmes et de l’augmentation des inégalités sociales sont au cœur de ces débats. L’IA est souvent accusée de véhiculer des stéréotypes préjudiciables et d’avoir des répercussions désastreuses, surtout pour les populations vulnérables. Cette réalité est d’autant plus frappante à l’approche de grands événements comme le Sommet mondial sur l’IA, prévu à Paris, où les voix des ONG risquent d’être étouffées par des discours centrés sur la croissance économique et l’innovation technologique. Face à cette situation, il est crucial d’insister sur la nécessité de réglementer l’IA en intégrant des principes de justice sociale et environnementale.

L’impact de l’IA sur les inégalités sociales est de plus en plus préoccupant. Les algorithmes, qui sont souvent basés sur des données biaisées, peuvent aggraver les discriminations existantes dans les secteurs tels que l’emploi, la santé et l’éducation. Un exemple marquant est celui des algorithmes utilisés pour le recrutement. Nombre d’entre eux, conçus sans une réflexion adéquate sur les biais, peuvent systématiquement privilégier certains groupes démographiques au détriment d’autres, renforçant ainsi les inégalités raciales et de genre.

Des rapports récents, tels que le rapport sur l’état de l’IA dans les ONG, montrent comment ces technologies sont mises en œuvre dans le secteur associatif pour lutter contre ces biais, mais également comment elles peuvent, si mal utilisées, intensifier les préjugés actuels. Il convient de noter que les algorithmes utilisés dans les services publics, comme les allocations familiales, peuvent également exclure des groupes vulnérables en raison de critères d’analyse injustes.

Discrimination algorithmique et ses conséquences

Les biais algorithmiques s’infiltrent dans de nombreux aspects de la vie quotidienne. Par exemple, l’utilisation de l’IA dans le domaine de la santé a révélé des biais sexistes et racistes, affectant ainsi l’accès à des soins de qualité pour certaines populations. Le scandale des algorithmes de santé qui ne tiennent pas compte de la diversité ethnique des patients démontre à quel point ces technologies peuvent perpétuer les inégalités. De plus, dans le milieu carcéral, certaines IA chargées de prédire les risques de récidive ont montré un taux de ciblage disproportionné des accusés issus de minorités ethniques.

Cette dynamique souligne l’urgence d’une réflexion éthique sur l’utilisation des technologies d’IA et la nécessité d’intégrer des professionnels de la diversité dans le processus de conception de ces systèmes. Les organisations telles que le gouvernement français reconnaissent l’importance d’aborder ces enjeux, cependant bien peu d’actions semblent se concrétiser face à l’ampleur de ces défis.

La vision des ONG sur la réglementation de l’IA

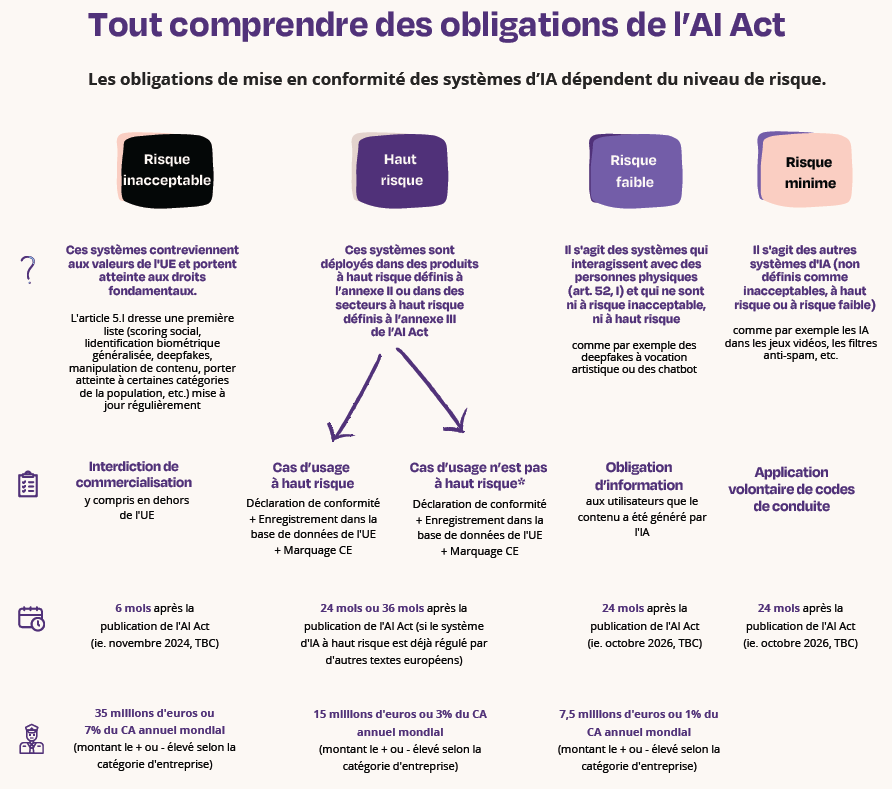

La réglementation de l’IA est devenue un sujet brûlant dans les discussions internationales. Les ONG réclament la mise en place de régulations strictes afin de protéger les droits humains, de garantir la transparence des algorithmes et d’assurer une utilisation équitable des technologies. Il est impératif que les technologies soient conçues dans le respect des droits fondamentaux et non pas comme des outils de profit au seul bénéfice d’à quelques multinationales. Un cadre juridique solide doit être mis en place pour répondre aux défis que pose l’IA, notamment en ce qui concerne les biais discriminatoires et l’accès aux ressources. Cette réglementation doit également tenir compte des aspirations environnementales, en s’assurant que l’IA ne contribue pas à la dégradation de notre planète.

Les recommandations formulées par les ONG soulignent la nécessité d’un dialogue inclusif entre citoyens, décideurs et experts en technologie pour bâtir une réglementation conforme aux valeurs démocratiques et aux principes d’équité. Les droits humains doivent être au cœur des discussions sur l’IA, et les incidents passés liés à des technologies mal conçues doivent servir de leçon pour l’avenir. Les voix des ONG doivent être amplifiées dans ces débats pour garantir que les perspectives des populations les plus touchées soient entendues.

Les défis de la mise en œuvre de régulations

Implémenter des régulations efficaces pour l’IA présente des défis complexes. Les rapides évolutions de la technologie laissent souvent les législateurs en retard. Ils doivent jongler avec un équilibre délicat entre innovation et restriction pour ne pas freiner le développement des solutions bénéfiques. Le rapport du Sénat sur l’IA souligne que sans un cadre légal clair, il devient difficile de sanctionner les entreprises qui agissent de manière irresponsable. La collaboration entre les gouvernements, le secteur privé et la société civile est essentielle afin de bâtir des solutions qui répondent tant aux impératifs d’innovation qu’aux besoins de protection des droits humains.

Les opportunités de l’IA pour le secteur associatif

Bien que l’IA soulève de nombreux enjeux, elle offre également des opportunités significatives pour le secteur associatif. L’adoption de ces technologies permet aux ONG de mieux cibler leurs interventions, d’optimiser leurs ressources et de maximiser leurs impacts. Par exemple, des organisations à but non lucratif commencent à utiliser des outils d’IA pour traiter de grandes quantités de données et obtenir des analyses précieuses. Une étude a montré que les ONG peuvent identifier plus efficacement les régions à risque et anticiper les besoins des populations vulnérables grâce à des systèmes d’analyse prédictive. Cela illustre comment l’IA, si elle est déployée de manière responsable, peut devenir un véritable allié pour la bonne cause.

Le potentiel de mobiliser de nouvelles ressources et de renforcer les communautés à travers des projets soutenus par l’IA souligne l’importance d’une formation adéquate pour les acteurs associatifs. Des compétences en gestion des données et en programmation deviennent de plus en plus nécessaires à mesure que l’IA joue un rôle de plus en plus déterminant dans le secteur.

Éducation et sensibilisation à l’IA

La transformation numérique du secteur associatif passe également par une phase d’éducation et de sensibilisation. Les ONG doivent se préparer à la nouvelle ère numérique et comprendre les enjeux éthiques que pose l’IA. Organiser des formations et des séminaires pour familiariser les membres et le personnel avec ces outils est essentiel. En effectuant cela, elles peuvent garantir que l’IA soit déployée de façon à servir les intérêts des populations et à renforcer, plutôt qu’à nuire, l’équité sociale. Des initiatives de sensibilisation auprès du grand public peuvent également jouer un rôle crucial. En cela, les ONG se montrent également comme des précurseurs dans l’éducation à l’IA, en prenant en compte les besoins divers des collectivités qu’elles desservent.

Perspectives d’avenir pour les ONG et l’IA

L’avenir des ONG et de l’IA est étroitement lié à la capacité des organisations à s’adapter aux nouvelles réalités numériques. Pour garantir que ces technologies desservent effectivement l’intérêt général, il est essentiel de développer un environnement législatif qui favorise la transparence et la collaboration. Les ONG doivent continuer à défendre des espaces où les voix des plus vulnérables sont prises en compte dans la conception et l’application des technologies d’IA. Une collaboration étroite entre les acteurs du secteur clé et les organisations de la société civile est donc primordiale pour s’assurer que l’IA est utilisée comme un outil d’émancipation plutôt que comme un instrument d’oppression.

Un cadre international reconnu pour guider l’utilisation de l’IA dans le respect des droits humains peut également s’avérer nécessaire. Les données partagées à travers les frontières doivent se conformer à des normes éthiques claires, aidant ainsi à éviter les abus de systèmes d’IA qui entravent la liberté d’expression ou exploitent certains groupes. En ce sens, les ONG ont un rôle fondamental à jouer pour appuyer des politiques durables qui privilégient les droits de tous.