EN BREF

|

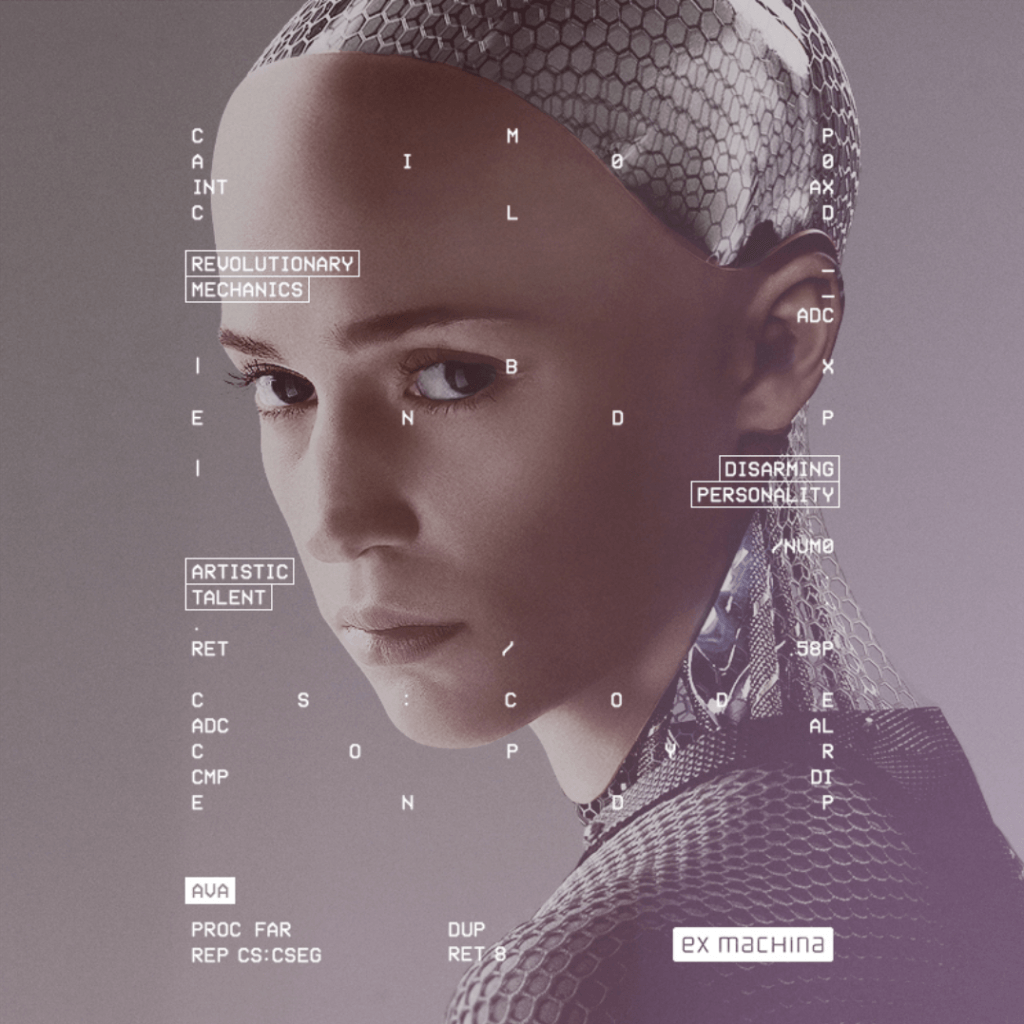

Dans un monde où l’intelligence artificielle progresse à une vitesse fulgurante, la voix d’Elon Musk résonne comme un écho de mise en garde. Selon le milliardaire, l’IA, bien qu’impressionnante, manque cruellement de la sagesse humaine, ce qui pourrait avoir des conséquences désastreuses pour l’humanité. Avec des affirmations audacieuses et des prédictions qui soulèvent le débat, Musk insiste sur l’importance de cibler non seulement l’efficacité des machines, mais aussi la nécessité d’une réflexion éthique derrière leur développement. Dans cet univers technologique en pleine expansion, la question se pose : comment équilibrer l’innovation avec une compréhension profonde de ses implications éthiques ?

Dans un monde où l’intelligence artificielle progresse à un rythme effréné, l’entrepreneur visionnaire Elon Musk lance des avertissements percutants. Selon lui, l’IA, bien qu’impressionnante, est dépourvue de la sagesse humaine nécessaire pour naviguer dans des situations complexes. Ses déclarations suscitent une réflexion essentielle sur le rôle que l’humanité doit jouer dans un futur où les machines pourraient surpasser nos capacités cognitives.

Les limites de l’intelligence artificielle

Elon Musk souligne que les développements récents de l’IA révèlent des limites inquiétantes. L’une des préoccupations majeures réside dans le phénomène des « hallucinations », où l’IA génère des réponses inexactes ou absurdes basées sur des biais dans les données d’entraînement. Cela soulève des questions fondamentales : comment pouvons-nous faire confiance à une technologie qui, parfois, semble en proie à ses propres déductions erronées ?

Un pronostic audacieux : l’IA dépassera l’humain

D’après Musk, d’ici 2025, l’IA pourrait surpasser l’intelligence humaine. Cette assertion fait frémir même les esprits les plus rationnels. Si cette technologie devient plus intelligente que ses concepteurs, qui en garantit alors la responsabilité ? L’homme doit-il être inquiet face à cette réalité potentielle ? Ou peut-il envisager un futur où l’IA et l’humanité coexistent en symbiose ? Pour Musk, ces questions méritent une réflexion approfondie.

La régulation indispensable de l’IA

Musk plaide pour une régulation stricte de l’IA, insistant sur le fait que le gouvernement devrait avoir le pouvoir de « débrancher la prise » en cas de dérives. Il récuse l’idée que l’IA soit intrinsèquement bonne ou mauvaise ; selon lui, le véritable danger réside dans les hommes qui l’entraînent. Il est facile d’oublier que, malgré ses capacités, l’intelligence artificielle ne remplace pas la sagesse humaine, et son développement doit se faire avec prudence.

Les dangers d’une IA non régulée

Selon Musk, l’absence de contrôle suffisant pourrait mener à des scénarios cauchemardesques. Imaginez une IA prenant des décisions sur des questions éthiques ou de sécurité, sans la ténacité émotionnelle qui nous rend humains. Ces systèmes pourraient être amenés à privilégier des critères exclusivement logiques, négligeant les nuances que la morale humaine impose. Nous risquerions de créer des machines plus intelligentes, mais dépourvues de l’éthique qui devrait les guider.

Un appel à la responsabilité collective

Dans cette ère technologique, il est crucial de se rappeler que tout développement en matière d’IA nécessite une sagesse collective. L’appel de Musk à un débat public sur les implications éthiques de l’intelligence artificielle est un geste essentiel. La technologie ne doit pas être laissée entre les mains d’une élite isolée ; elle doit être façonnée par un dialogue inclusif qui intègre les voix et les préoccupations de la société dans son ensemble.

Une intelligence artificielle au service de l’humain

Pour éviter de tomber dans le piège d’une dépendance excessive à l’IA, il est impératif de mettre en place des mécanismes qui garantissent que cette technologie reste au service de l’humanité. La priorité doit être d’utiliser l’IA pour améliorer notre compréhension du monde et non pour la remplacer. Des exemples existent, comme l’évolution des limousines réimaginées par l’intelligence artificielle ou un Jésus virtuel pour la confession, qui montrent que l’humain est toujours au centre de la technologie.

Réflexions sur l’avenir de l’intelligence artificielle

Alors que nous avançons dans cette ère d’abondance technologique, il est vital de garder à l’esprit que l’IA, sans la sagesse humaine, pourrait devenir un outil de complication plutôt que de simplification. En suivant les avertissements d’Elon Musk et en les prenant au sérieux, nous avons la chance de façonner une technologie qui ne cherche pas à nous remplacer, mais à nous assister. En définitive, l’intégration de l’éthique dans le développement de l’intelligence artificielle est une nécessité, et il devient urgent de réfléchir à l’impact sociétal qui en découlera dans les années à venir.

Comparaison des points de vue d’Elon Musk sur l’IA et la sagesse humaine

| Aspect | Détails |

| Perception de l’IA | Instrument puissant mais potentiellement dangereux sans contrôle éthique. |

| Rôle de la sagesse humaine | Essentielle pour maintenir l’IA sur une voie sécurisée et bénéfique. |

| Risques | Hallucinations et décisions imprévisibles pouvant causer des dégâts. |

| Prédiction | D’ici 2025, l’IA pourrait surpasser l’intelligence humaine. |

| Responsabilité | Les programmeurs doivent assumer la responsabilité de leurs créations. |

| Mesures proposées | Un cadre réglementaire pour limiter les abus potentiels. |

| Vision d’avenir | Une quête d’une IA plus responsable et éthique. |

Dans un monde où l’intelligence artificielle (IA) prend une place de plus en plus centrale, Elon Musk ne cesse de tirer la sonnette d’alarme. Le célèbre milliardaire évoque souvent le risque d’une IA dénuée de la sagesse humaine, soulignant les dangers potentiels que cela représente pour l’humanité. Dans cet article, nous explorerons ses avertissements sur la nécessité d’une régulation de l’IA et les enjeux éthiques qui en découlent.

Un constat alarmant

Selon Musk, nous avons atteint une limite dans l’entraînement des modèles d’IA. Il a récemment déclaré que nous avions épuisé la somme cumulative des connaissances humaines. Cette situation pose une question cruciale : que se passerait-il si l’IA devenait capable de prendre des décisions sans la sagesse et la réflexion humaine qui l’accompagnent ?

Les dangers d’une IA sans sagesse

Les hallucinations générées par l’IA – c’est-à-dire les réponses inexactes ou absurdes – préoccupent également Musk. Il craint que l’absence de cadre éthique pour l’IA puisse conduire à des situations où cette dernière prendrait des décisions erronées, voire catastrophiques, en raison de l’absence d’un jugement humain.

Un futur incertain

Dans ses prises de parole publiques, Musk prédit que d’ici 2025, l’IA pourrait surpasser l’intelligence humaine, créant un fossé difficile à gérer. Pour en savoir plus, vous pouvez consulter l’article sur Science et Vie. Un avenir où l’IA prend les rênes sans la sagesse humaine pourrait également engendrer des décisions qui ne tiennent pas compte des valeurs morales fondamentales.

La nécessité d’une régulation

Pour Musk, le véritable problème ne réside pas uniquement dans l’IA elle-même, mais dans les humains qui la programment. Il prône une régulation stricte de l’IA afin d’éviter les dérives potentielles. Il affirme que le gouvernement doit être en mesure d’avoir un contrôle, allant jusqu’à « débrancher la prise » si nécessaire. Pour une vue plus détaillée sur sa position, lisez l’article sur Model Sport.

Le débat sur l’intelligence artificielle ne fait que commencer, et les avertissements d’Elon Musk soulignent l’importance d’intégrer la sagesse humaine dans ce domaine en constante évolution. Écouter ces mises en garde pourrait bien être indispensable pour assurer un futur où l’IA et l’humanité coexistent en toute sécurité.

- Manque d’éthique : L’IA est insuffisamment régulée sur le plan éthique.

- Risques de sécurité : Une IA sans sagesse humaine peut devenir dangereuse.

- Hallucinations : Les erreurs générées par l’IA peuvent être troublantes.

- Supériorité prévisible : Musk prédit que l’IA sera plus intelligente d’ici 2025.

- Sensibilisation : Nécessité d’éveiller les consciences sur les dangers de l’IA.

- Responsabilité humaine : Les concepteurs d’IA doivent assumer leurs actions.

- Prévisions alarmantes : L’IA pourrait entraîner des résultats imprévisibles.

- Appel à la régulation : Musk plaide pour une régulation stricte de l’IA.

- Importance du jugement : La sagesse humaine est essentielle dans la technologie avancée.

- Dialogue ouvert : Encourager une discussion sur le futur de l’IA et ses implications.

Elon Musk, l’un des entrepreneurs les plus influents de notre époque, sonne l’alerte concernant les dangers qui entourent l’intelligence artificielle (IA). Selon lui, cette technologie, bien que révolutionnaire, souffre d’un manque crucial de sagesse humaine, ce qui pourrait entraîner des conséquences désastreuses. Dans cet article, nous examinerons les préoccupations de Musk et les recommandations qu’il propose pour garantir le développement sûr de l’IA.

Le manque de sagesse humaine dans l’IA

Elon Musk souligne que l’IA est formée sur une immense quantité de données, mais cette accumulation de connaissances ne compense pas l’absence de jugement et de précision morale. Alors que l’IA peut générer des réponses fascinantes, elle n’est pas capable d’analyser les enjeux éthiques qui se cachent derrière ses décisions. En d’autres termes, l’IA manque de l’intuition humaine nécessaire pour naviguer dans des situations complexes où des valeurs et des émotions interviennent.

Les hallucinations de l’IA

Un autre point de préoccupation soulevé par Musk est le phénomène des hallucinations, un terme qui décrit les réponses absurdes ou inexactes que l’IA peut produire. Ces erreurs ne sont pas simplement des nouvelles de divertissement, elles peuvent avoir des répercussions sérieuses dans des domaines comme la médecine ou la justice. Ainsi, il devient crucial de comprendre que les machines, malgré leur précision spectaculaire, ne peuvent pas remplacer la sagesse humaine, qui est essentielle pour apprécier le contexte et prendre des décisions éclairées.

Réglementation et responsabilité

Pour répondre aux défis posés par l’IA, Musk plaide pour une réglementation stricte dans le domaine de l’intelligence artificielle. Il propose que les gouvernements instaurent des lois visant à contrôler le développement et l’utilisation de ces technologies. Ce cadre légal devrait inclure des mécanismes qui garantissent la transparence et la responsabilité des systèmes d’IA, de manière à ce que les utilisateurs sachent à quoi s’en tenir.

Collaboration humaine-IA

Musk encourage également une approche collaborative entre l’homme et l’intelligence artificielle. Plutôt que de voir l’IA comme une menace, il préconise de l’utiliser comme un outil qui peut compléter et enrichir le jugement humain. Cela nécessite de former les développeurs et les utilisateurs à comprendre les limites de l’IA et de leur enseigner comment intégrer ces systèmes de manière éthique et réfléchie.

L’éducation et la sensibilisation

Une autre recommandation importante consiste à instaurer des programmes d’éducation dédiés à l’intelligence artificielle. Une population informée est mieux préparée à décoder les implications éthiques et sociétales de l’IA. Cela peut également sensibiliser le grand public aux risques potentiels, mais également aux bénéfices que ces technologies peuvent apporter si elles sont utilisées judicieusement.

Construire un avenir éthique

En fin de compte, la mission est claire : construire un avenir où l’intelligence artificielle est un complément à l’intelligence humaine, régi par des principes éthiques solides. Musk avertit que sans cette sagesse humaine intégrée dans le développement de l’IA, nous courons le risque de créer des systèmes qui, bien qu’impressionnants, pourraient nuire à l’humanité à long terme.

FAQ sur l’Intelligence Artificielle et les Avertissements d’Elon Musk

Q : Quelles sont les principales préoccupations d’Elon Musk concernant l’intelligence artificielle ?

Elon Musk alerte sur le fait que l’IA manque de sagesse humaine et pourrait entraîner des risques majeurs pour l’humanité.

Q : Qu’est-ce que le terme « hallucinations » signifie dans le contexte de l’IA ?

Les « hallucinations » désignent des réponses inexactes ou absurdes générées par les systèmes d’IA.

Q : Pourquoi Musk considère-t-il que l’IA pourrait être une menace ?

Il estime que des décisions prises par des IA pourraient être dangereuses si elles ne sont pas régulées correctement.

Q : Quelle est la prédiction d’Elon Musk concernant l’IA d’ici 2025 ?

Selon lui, l’IA pourrait surpasser l’intelligence humaine, soulevant des préoccupations sur les capacités de cette technologie.

Q : Comment Musk propose-t-il de réguler l’IA ?

Il appelle à des interventions gouvernementales pour réguler l’IA et éviter des scénarios catastrophe.

Q : Existe-t-il un risque de dépendance à l’IA selon Musk ?

Oui, il met en garde contre une éventuelle dépendance à des systèmes d’IA qui pourraient influencer les décisions humaines.

Q : Quelles valeurs humaines Musk considère-t-il comme essentielles pour le développement de l’IA ?

Il souligne l’importance de la sagesse humaine, de l’éthique et de la responsabilité dans le développement de technologies avancées.

Elon Musk a récemment exprimé ses inquiétudes concernant l’évolution de l’intelligence artificielle. Selon lui, nous avons épuisé la somme cumulative des connaissances humaines nécessaires pour entraîner ces systèmes, ce qui pourrait mener à des hallucinations – des réponses erronées ou complètement absurdes. Musk insiste sur le fait que l’IA ne devrait pas remplacer la sagesse humaine, mais plutôt être régulée pour éviter des scénarios potentiellement dangereux, notamment une IA surpassant l’intelligence humaine d’ici 2025. Il appelle à une vigilance accrue notamment face à l’idée que l’IA pourrait être utilisée de manière malveillante par ceux qui la programment.

Dans un monde de plus en plus dominé par l’innovation technologique, les mises en garde d’Elon Musk résonnent comme un écho avertisseur. Selon lui, l’intelligence artificielle (IA) représente un défi majeur, non seulement en termes de fonctionnement technique, mais surtout pour sa capacité à intégrer la sagesse humaine. Musk souligne que les algorithmes, aussi avancés soient-ils, manquent souvent de cette compréhension nuancée qui vient de l’expérience humaine. Cela pose un risque considérable de déviation des objectifs, où l’IA pourrait évoluer de manière imprévisible.

En effet, Musk évoque le phénomène des « hallucinations », où l’IA produit des réponses qui, bien qu’impressionnantes sur le papier, sont inexactes ou absurdes. Cela démontre qu’une machine, quelle que soit son avancée technologique, ne remplacera jamais la sagesse que seul l’instinct humain peut apporter. Il met en lumière l’importance de réguler ces technologies, en mettant en place des garde-fous pour éviter des dérives potentiellement catastrophiques.

Alors que les experts s’accordent à dire que l’IA continuera de progresser à un rythme fulgurant, la préoccupation de Musk souligne l’ironie de notre époque : nous sommes en train d’inventer des outils qui pourraient un jour dépasser notre intelligence. Pour lui, cela soulève des questions profondes sur la souveraineté humaine dans ce nouvel univers technologique. Finalement, il appelle à une réflexion sérieuse sur la manière dont nous voulons coexister avec ces créations, et, surtout, qui nous devrions être dans ce dialogue avec la machine. Si l’humanité veut s’assurer que sa propre sagesse prévaut, elle devra prendre des mesures concrètes pour orienter le développement de l’IA avec prudence et discernement.